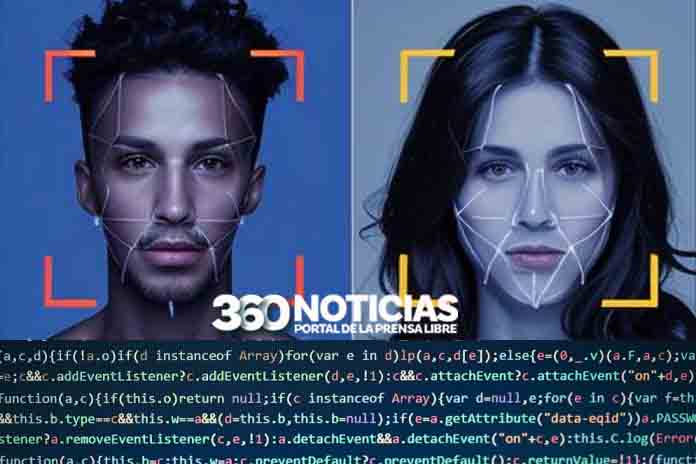

(360Noticias) Un estudio reciente, publicado en American Psychologist, ha generado preocupaciones significativas sobre la privacidad y la ética en el campo de la inteligencia artificial (IA). Este estudio revela que la IA puede predecir las orientaciones políticas de las personas a partir de imágenes de sus rostros sin expresión, planteando serias interrogantes sobre el alcance y el potencial abuso de esta tecnología emergente.

El autor principal del estudio, Michal Kosinski, profesor asociado de comportamiento organizacional en la Escuela de Posgrado de Negocios de la Universidad de Stanford, describió los hallazgos como una “advertencia histórica” sobre la tecnología de reconocimiento facial. El estudio utilizó un algoritmo de reconocimiento facial para analizar imágenes altamente controladas de participantes. Sorprendentemente, encontraron que la IA podía predecir con precisión las orientaciones políticas de las personas a partir de estas imágenes, incluso cuando los rostros estaban en blanco.

Para llevar a cabo la investigación, los participantes fueron sometidos a una rigurosa preparación para asegurar que las imágenes fueran lo más neutrales posible. Se les pidió que usaran camisetas negras ajustadas y se les proporcionaron clips de carpeta para cubrir su ropa. Además, se eliminaron joyas y, si era necesario, se afeitó el vello facial. Este nivel de control refuerza la seriedad de los resultados obtenidos y destaca la preocupación sobre el alcance de la tecnología de reconocimiento facial.

Los resultados del estudio plantean preguntas importantes sobre la privacidad y el consentimiento en un mundo cada vez más dominado por la tecnología. Kosinski advierte que la exposición en línea a través de plataformas como Facebook puede ser riesgosa, ya que la tecnología puede revelar información sensible sin el consentimiento de los individuos. Anteriormente, la orientación sexual, las opiniones políticas y religiosas solían ser públicas en plataformas como Facebook. Sin embargo, con el tiempo, se reconoció la importancia de proteger esta información privada, y las políticas de privacidad se han vuelto más estrictas. Kosinski enfatiza que la tecnología de reconocimiento facial plantea desafíos aún mayores en términos de privacidad personal, ya que puede revelar información sin el conocimiento ni el consentimiento de los individuos.

El estudio también subraya la importancia de considerar políticas más estrictas para regular la grabación y el procesamiento de imágenes faciales. Los hallazgos sugieren que incluso características faciales estables pueden transmitir información política, lo que destaca la necesidad de proteger la privacidad de las personas en un mundo cada vez más digitalizado. Los autores del estudio concluyen que los académicos, el público y los responsables políticos deben tomar nota de estos hallazgos y considerar medidas para abordar los riesgos potenciales asociados con la tecnología de reconocimiento facial.

En respuesta a estos desafíos, el representante Jay Obernolte fue seleccionado para dirigir un grupo de trabajo sobre inteligencia artificial en la Cámara de Representantes. Este grupo de trabajo buscará abordar los avances tecnológicos y sus implicaciones para la sociedad y la privacidad. Obernolte, un republicano de California, ha expresado su compromiso de abordar los desafíos éticos y legales asociados con la IA y de trabajar para garantizar que se protejan los derechos y la privacidad de los ciudadanos.